Metodi di ricerca in psicologia

Il Gennaio 4, 2022 da adminObiettivi di apprendimento

- Definire la ricerca correlazionale e fornire diversi esempi.

- Spiegare perché un ricercatore potrebbe scegliere di condurre una ricerca correlazionale piuttosto che una ricerca sperimentale o un altro tipo di ricerca non sperimentale.

- Interpretare la forza e la direzione dei diversi coefficienti di correlazione.

- Spiegare perché la correlazione non implica causalità.

Che cos’è la ricerca correlazionale?

La ricerca correlazionale è un tipo di ricerca non sperimentale in cui il ricercatore misura due variabili (binarie o continue) e valuta la relazione statistica (cioè, la correlazione) tra di esse con poco o niente, la correlazione) tra loro con poco o nessun sforzo per controllare le variabili estranee. Ci sono molte ragioni per cui i ricercatori interessati alle relazioni statistiche tra le variabili sceglierebbero di condurre uno studio correlazionale piuttosto che un esperimento. La prima è che non credono che la relazione statistica sia causale o non sono interessati alle relazioni causali. Ricordiamo che due obiettivi della scienza sono descrivere e prevedere e la strategia di ricerca correlazionale permette ai ricercatori di raggiungere entrambi questi obiettivi. In particolare, questa strategia può essere usata per descrivere la forza e la direzione della relazione tra due variabili e se c’è una relazione tra le variabili, allora i ricercatori possono usare i punteggi su una variabile per prevedere i punteggi sull’altra (usando una tecnica statistica chiamata regressione, che è discussa ulteriormente nella sezione sulla Correlazione Complessa in questo capitolo).

Un’altra ragione per cui i ricercatori sceglierebbero di usare uno studio correlazionale piuttosto che un esperimento è che la relazione statistica di interesse è ritenuta causale, ma il ricercatore non può manipolare la variabile indipendente perché è impossibile, poco pratico o non etico. Per esempio, mentre un ricercatore potrebbe essere interessato alla relazione tra la frequenza con cui le persone usano la cannabis e le loro capacità di memoria, non può eticamente manipolare la frequenza con cui le persone usano la cannabis. Come tale, deve affidarsi alla strategia della ricerca correlazionale; deve semplicemente misurare la frequenza con cui le persone usano la cannabis e misurare le loro capacità di memoria usando un test standardizzato di memoria e poi determinare se la frequenza con cui le persone usano la cannabis è statisticamente correlata alle prestazioni del test di memoria.

La correlazione è anche usata per stabilire l’affidabilità e la validità delle misure. Per esempio, un ricercatore potrebbe valutare la validità di un breve test di estroversione somministrandolo ad un grande gruppo di partecipanti insieme ad un test di estroversione più lungo che ha già dimostrato di essere valido. Questo ricercatore potrebbe poi controllare se i punteggi dei partecipanti al test breve sono fortemente correlati con i loro punteggi su quello più lungo. Si pensa che nessuno dei due punteggi del test sia la causa dell’altro, quindi non c’è nessuna variabile indipendente da manipolare. Infatti, i termini variabile indipendente e variabile dipendente non si applicano a questo tipo di ricerca.

Un altro punto di forza della ricerca correlazionale è che spesso ha una validità esterna superiore alla ricerca sperimentale. Ricordiamo che c’è tipicamente un compromesso tra validità interna e validità esterna. Quando si aggiungono maggiori controlli agli esperimenti, la validità interna aumenta, ma spesso a spese della validità esterna, poiché vengono introdotte condizioni artificiali che non esistono nella realtà. Al contrario, gli studi correlazionali hanno tipicamente una bassa validità interna perché nulla è manipolato o controllato, ma spesso hanno un’alta validità esterna. Poiché nulla è manipolato o controllato dallo sperimentatore, è più probabile che i risultati riflettano relazioni che esistono nel mondo reale.

Infine, estendendo questo compromesso tra validità interna ed esterna, la ricerca correlazionale può aiutare a fornire prove convergenti per una teoria. Se una teoria è supportata da un vero esperimento che ha un’alta validità interna e da uno studio correlazionale che ha un’alta validità esterna, i ricercatori possono avere più fiducia nella validità della loro teoria. Come esempio concreto, gli studi correlazionali che stabiliscono che c’è una relazione tra guardare la televisione violenta e il comportamento aggressivo sono stati integrati da studi sperimentali che confermano che la relazione è causale (Bushman & Huesmann, 2001).

La ricerca correlazionale coinvolge sempre variabili quantitative?

Un malinteso comune tra i ricercatori principianti è che la ricerca correlazionale deve coinvolgere due variabili quantitative, come i punteggi di due test dell’estroversione o il numero di seccature quotidiane e il numero di sintomi sperimentati dalle persone. Tuttavia, la caratteristica che definisce la ricerca correlazionale è che le due variabili sono misurate – nessuna delle due è manipolata – e questo è vero indipendentemente dal fatto che le variabili siano quantitative o categoriche. Immaginate, per esempio, che un ricercatore somministri la Rosenberg Self-Esteem Scale a 50 studenti americani e 50 giapponesi. Anche se questo “sembra” un esperimento tra soggetti, è uno studio correlazionale perché il ricercatore non ha manipolato la nazionalità degli studenti. Lo stesso vale per lo studio di Cacioppo e Petty che confronta docenti universitari e operai in termini di bisogno di cognizione. Si tratta di uno studio correlazionale perché i ricercatori non hanno manipolato le occupazioni dei partecipanti.

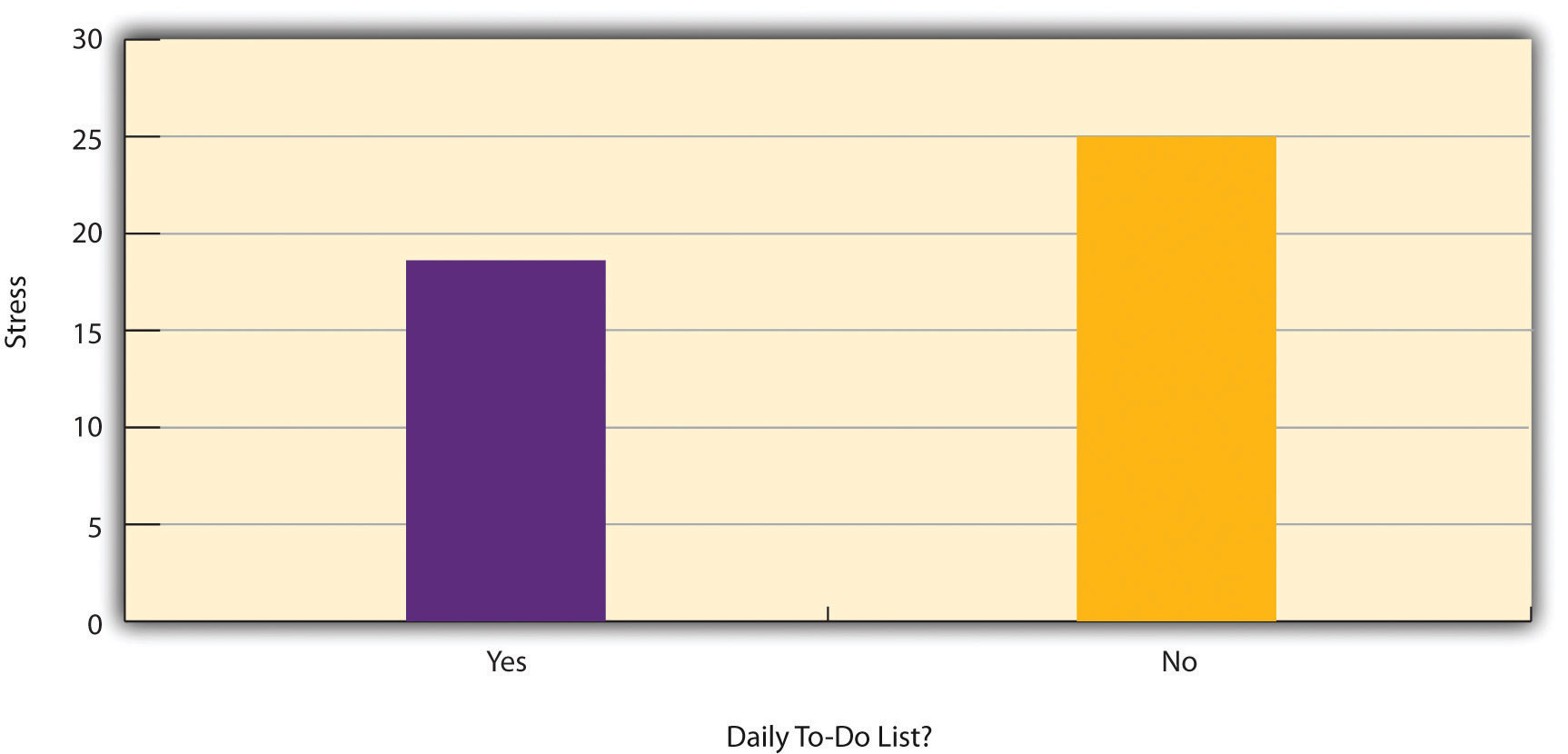

La figura 6.2 mostra i dati di un ipotetico studio sulla relazione tra il fatto che le persone facciano o meno una lista giornaliera di cose da fare (una “to-do list”) e lo stress. Notate che non è chiaro se questo è un esperimento o uno studio correlazionale perché non è chiaro se la variabile indipendente è stata manipolata. Se il ricercatore ha assegnato a caso alcuni partecipanti a fare liste di cose da fare e altri no, allora è un esperimento. Se il ricercatore ha semplicemente chiesto ai partecipanti se facevano liste di cose da fare ogni giorno, allora si tratta di uno studio correlazionale. La distinzione è importante perché se lo studio fosse un esperimento, allora si potrebbe concludere che fare le liste di cose da fare quotidiane ha ridotto lo stress dei partecipanti. Ma se fosse uno studio correlazionale, si potrebbe solo concludere che queste variabili sono statisticamente correlate. Forse essere stressati ha un effetto negativo sulla capacità delle persone di pianificare in anticipo (il problema della direzionalità). O forse le persone che sono più coscienziose hanno più probabilità di fare liste di cose da fare e meno probabilità di essere stressate (il problema della terza variabile). Il punto cruciale è che ciò che definisce uno studio come sperimentale o correlazionale non sono le variabili studiate, né se le variabili sono quantitative o categoriche, né il tipo di grafico o di statistica usato per analizzare i dati. Ciò che definisce uno studio è il modo in cui lo studio viene condotto.

Raccolta dati nella ricerca correlazionale

Ancora una volta, la caratteristica che definisce la ricerca correlazionale è che nessuna variabile viene manipolata. Non importa come o dove le variabili sono misurate. Un ricercatore potrebbe far venire i partecipanti in un laboratorio per completare un compito computerizzato di backward digit span e un compito computerizzato di decisione rischiosa e poi valutare la relazione tra i punteggi dei partecipanti sui due compiti. Oppure un ricercatore potrebbe andare in un centro commerciale per chiedere alle persone i loro atteggiamenti verso l’ambiente e le loro abitudini di acquisto e poi valutare la relazione tra queste due variabili. Entrambi questi studi sarebbero correlazionali perché nessuna variabile indipendente viene manipolata.

Correlazioni tra variabili quantitative

Le correlazioni tra variabili quantitative sono spesso presentate usando diagrammi di dispersione. La figura 6.3 mostra alcuni dati ipotetici sulla relazione tra la quantità di stress a cui sono sottoposte le persone e il numero di sintomi fisici che hanno. Ogni punto nel grafico a dispersione rappresenta il punteggio di una persona su entrambe le variabili. Per esempio, il punto cerchiato nella Figura 6.3 rappresenta una persona il cui punteggio di stress era 10 e che aveva tre sintomi fisici. Prendendo in considerazione tutti i punti, si può vedere che le persone sottoposte a più stress tendono ad avere più sintomi fisici. Questo è un buon esempio di relazione positiva, in cui punteggi più alti su una variabile tendono ad essere associati a punteggi più alti sull’altra. In altre parole, si muovono nella stessa direzione, sia verso l’alto che verso il basso. Una relazione negativa è quella in cui punteggi più alti su una variabile tendono ad essere associati a punteggi più bassi sull’altra. In altre parole, si muovono in direzioni opposte. C’è una relazione negativa tra lo stress e il funzionamento del sistema immunitario, per esempio, perché uno stress più alto è associato a un funzionamento più basso del sistema immunitario.

La forza di una correlazione tra variabili quantitative è tipicamente misurata usando una statistica chiamata coefficiente di correlazione di Pearson (o r di Pearson). Come mostra la Figura 6.4, l’r di Pearson varia da -1.00 (la più forte relazione negativa possibile) a +1.00 (la più forte relazione positiva possibile). Un valore di 0 significa che non c’è alcuna relazione tra le due variabili. Quando l’r di Pearson è 0, i punti su un grafico di dispersione formano una “nuvola” informe. Man mano che il suo valore si sposta verso -1.00 o +1.00, i punti si avvicinano sempre più a cadere su una singola linea retta. I coefficienti di correlazione vicino a ±.10 sono considerati piccoli, i valori vicino a ±.30 sono considerati medi, e i valori vicino a ±.50 sono considerati grandi. Si noti che il segno dell’r di Pearson non è correlato alla sua forza. I valori di r di Pearson di +.30 e -.30, per esempio, sono ugualmente forti; è solo che uno rappresenta una relazione positiva moderata e l’altro una relazione negativa moderata. Con l’eccezione dei coefficienti di affidabilità, la maggior parte delle correlazioni che troviamo in Psicologia sono di piccole o moderate dimensioni. Il sito web http://rpsychologist.com/d3/correlation/, creato da Kristoffer Magnusson, fornisce un’eccellente visualizzazione interattiva delle correlazioni che permette di regolare la forza e la direzione di una correlazione mentre si assiste ai corrispondenti cambiamenti dello scatterplot.

Ci sono due situazioni comuni in cui il valore di r di Pearson può essere fuorviante. L’r di Pearson è una buona misura solo per le relazioni lineari, in cui i punti sono meglio approssimati da una linea retta. Non è una buona misura per le relazioni non lineari, in cui i punti sono meglio approssimati da una linea curva. La figura 6.5, per esempio, mostra un’ipotetica relazione tra la quantità di sonno notturno delle persone e il loro livello di depressione. In questo esempio, la linea che approssima meglio i punti è una curva – una specie di “U” rovesciata – perché le persone che dormono circa otto ore tendono ad essere meno depresse. Quelli che dormono troppo poco e quelli che dormono troppo tendono ad essere più depressi. Anche se la Figura 6.5 mostra una relazione abbastanza forte tra la depressione e il sonno, l’r di Pearson sarebbe vicino allo zero perché i punti nel grafico di dispersione non si adattano bene a una singola linea retta. Questo significa che è importante fare uno scatterplot e confermare che una relazione è approssimativamente lineare prima di usare l’r di Pearson. Le relazioni non lineari sono abbastanza comuni in psicologia, ma misurare la loro forza è oltre lo scopo di questo libro.

L’altra situazione comune in cui il valore dell’r di Pearson può essere fuorviante è quando una o entrambe le variabili hanno una gamma limitata nel campione rispetto alla popolazione. Questo problema è chiamato restrizione di gamma. Supponiamo, per esempio, che ci sia una forte correlazione negativa tra l’età delle persone e il loro gradimento della musica hip hop, come mostrato dal grafico a dispersione nella Figura 6.6. L’r di Pearson qui è -.77. Tuttavia, se dovessimo raccogliere dati solo dai 18-24enni – rappresentati dall’area ombreggiata della Figura 6.6 – allora la relazione sembrerebbe essere piuttosto debole. Infatti, l’r di Pearson per questa gamma ristretta di età è 0. È una buona idea, quindi, progettare studi per evitare la restrizione della gamma. Per esempio, se l’età è una delle vostre variabili primarie, allora potete pianificare di raccogliere dati da persone di un’ampia gamma di età. Poiché la restrizione dell’intervallo non è sempre prevista o facilmente evitabile, tuttavia, è buona norma esaminare i dati per una possibile restrizione dell’intervallo e interpretare l’r di Pearson alla luce di essa. (Ci sono anche metodi statistici per correggere l’r di Pearson per la restrizione dell’intervallo, ma vanno oltre lo scopo di questo libro).

La correlazione non implica causalità

Avrete probabilmente sentito dire più volte che “La correlazione non implica causalità”. Un esempio divertente di questo viene da uno studio del 2012 che ha mostrato una correlazione positiva (r di Pearson = 0,79) tra il consumo di cioccolato pro capite di una nazione e il numero di premi Nobel assegnati ai cittadini di quella nazione. Sembra chiaro, tuttavia, che questo non significa che mangiare cioccolato induce le persone a vincere premi Nobel, e non avrebbe senso cercare di aumentare il numero di premi Nobel vinti raccomandando ai genitori di nutrire i loro figli con più cioccolato.

Ci sono due motivi per cui la correlazione non implica causalità. Il primo è chiamato il problema della direzionalità. Due variabili, X e Y, possono essere statisticamente correlate perché X causa Y o perché Y causa X. Si consideri, per esempio, uno studio che mostra che l’esercizio fisico o meno è statisticamente correlato a quanto sono felici – in modo tale che le persone che fanno esercizio sono in media più felici di quelle che non lo fanno. Questa relazione statistica è coerente con l’idea che l’esercizio fisico causi la felicità, ma è anche coerente con l’idea che la felicità causi l’esercizio fisico. Forse essere felici dà alle persone più energia o le porta a cercare opportunità per socializzare con gli altri andando in palestra. La seconda ragione per cui la correlazione non implica causalità è chiamata il problema della terza variabile. Due variabili, X e Y, possono essere statisticamente correlate non perché X causa Y, o perché Y causa X, ma perché una terza variabile, Z, causa sia X che Y. Per esempio, il fatto che le nazioni che hanno vinto più premi Nobel tendono ad avere un più alto consumo di cioccolato probabilmente riflette la geografia in quanto i paesi europei tendono ad avere più alti tassi di consumo di cioccolato pro capite e investono di più in istruzione e tecnologia (ancora una volta, pro capite) di molti altri paesi del mondo. Allo stesso modo, la relazione statistica tra esercizio fisico e felicità potrebbe significare che qualche terza variabile, come la salute fisica, causa entrambe le altre. Essere fisicamente sani potrebbe indurre le persone a fare esercizio fisico e farle essere più felici. Le correlazioni che sono il risultato di una terza variabile sono spesso chiamate correlazioni spurie.

Alcuni eccellenti e divertenti esempi di correlazioni spurie possono essere trovati a http://www.tylervigen.com (la Figura 6.7 ne fornisce uno).

“Lots of Candy Could Lead to Violence”

Anche se i ricercatori in psicologia sanno che la correlazione non implica causalità, molti giornalisti non lo fanno. Un sito web sulla correlazione e la causalità, http://jonathan.mueller.faculty.noctrl.edu/100/correlation_or_causation.htm, si collega a decine di servizi dei media su vere ricerche biomediche e psicologiche. Molti dei titoli suggeriscono che una relazione causale è stata dimostrata quando una lettura attenta degli articoli mostra che non è così a causa dei problemi di direzionalità e di terza variabile.

Uno di questi articoli parla di uno studio che dimostra che i bambini che mangiavano caramelle ogni giorno avevano più probabilità degli altri bambini di essere arrestati per un reato violento più tardi nella vita. Ma le caramelle potrebbero davvero “portare” alla violenza, come suggerisce il titolo? Quali spiegazioni alternative puoi pensare per questa relazione statistica? Come si potrebbe riscrivere il titolo in modo che non sia fuorviante?

Come avete imparato leggendo questo libro, ci sono vari modi in cui i ricercatori affrontano i problemi della direzionalità e della terza variabile. Il più efficace è condurre un esperimento. Per esempio, invece di misurare semplicemente quanto le persone fanno esercizio, un ricercatore potrebbe portare le persone in un laboratorio e assegnare a caso la metà di loro a correre su un tapis roulant per 15 minuti e il resto a sedersi su un divano per 15 minuti. Anche se questo sembra un cambiamento minore nel disegno della ricerca, è estremamente importante. Ora, se chi fa esercizio finisce per avere uno stato d’animo più positivo di chi non ha fatto esercizio, non può essere perché il loro stato d’animo ha influenzato quanto hanno fatto esercizio (perché è stato il ricercatore che ha usato l’assegnazione casuale per determinare quanto hanno fatto esercizio). Allo stesso modo, non può essere perché una terza variabile (ad esempio, la salute fisica) ha influenzato sia la quantità di esercizio che l’umore. Così gli esperimenti eliminano i problemi di direzionalità e di terza variabile e permettono ai ricercatori di trarre conclusioni definitive sulle relazioni causali.

Un grafico che presenta le correlazioni tra due variabili quantitative, una sull’asse delle x e una sull’asse delle y. I punteggi sono tracciati all’intersezione dei valori su ogni asse.

Un rapporto in cui punteggi più alti su una variabile tendono ad essere associati a punteggi più alti sull’altra.

Un rapporto in cui punteggi più alti su una variabile tendono ad essere associati a punteggi più bassi sull’altra.

Una statistica che misura la forza di una correlazione tra variabili quantitative.

Quando una o entrambe le variabili hanno una gamma limitata nel campione rispetto alla popolazione, rendendo il valore del coefficiente di correlazione fuorviante.

Il problema in cui due variabili, X e Y, sono statisticamente correlate o perché X causa Y, o perché Y causa X, e quindi la direzione causale dell’effetto non può essere conosciuta.

Due variabili, X e Y, possono essere statisticamente correlate non perché X causa Y, o perché Y causa X, ma perché una terza variabile, Z, causa sia X che Y.

Correlazioni che sono il risultato non delle due variabili misurate, ma piuttosto di una terza variabile, non misurata, che influenza entrambe le variabili misurate.

Lascia un commento